Cuando se proporcionaron a la gente herramientas de técnicas engañosas y se les dijo que «jugaran al troll ruso», aprendieron a rechazar la desinformación.

La acusación contra 13 rusos de intentar engañar al público, para influir en las elecciones presidenciales, muestra que Estados Unidos sigue siendo vulnerable a lo que la acusación llama «guerra de información», pero que otros denominan simplemente noticias falsas. Un artículo de investigación, publicado recientemente por dos investigadores de la Universidad de Cambridge, muestra cómo contrarrestarla.

Una vez que una persona acepta una falsedad, desoírla puede llegar a ser muy difícil, especialmente si el grupo social que está en la línea de esa persona es el que la auspicia. Algunas investigaciones han sugerido que esto se debe a que, la necesidad emocional de aceptación influye en el pensamiento racional de orden superior.

Una amplia muestra representativa de la investigación sugiere que, la mejor defensa contra la desinformación es vacunar a las personas contra ella, es decir, exponer a las personas a las noticias falsas que es probable que reciban.

Ésta es la razón por la que, la campaña presidencial francesa de Emmanuel Macron en 2017, estableció cuentas de correo electrónico honeypot (Un honeypot, o sistema trampa o señuelo, es una herramienta de seguridad informática, dispuesta en una red o sistema informático, para ser el objetivo de un posible ataque informático, y así poder detectarlo y obtener información del mismo y del atacante. Nota de Wikipedia), para atraer a los hackers rusos que apoyaban al aliado de Putin, Marine Le Pen (un hecho que la Defense One reveló en diciembre de 2016).

Cuando los correos electrónicos de Macron se filtraron y las cuentas de medios sociales vinculados a los rusos comenzaron a difundir noticias de las filtraciones -y la desinformación sobre su contenido- la campaña de Macron fue capaz de desacreditar fácilmente los esfuerzos. La operación rusa fracasó.

La vacuna es la clave para contrarrestar la desinformación «, dijo John Cook, investigador de la Universidad George Mason, cuyo trabajo sobre la teoría de la inoculación fue citada en el documento de Cambridge. «Hay varias formas de abordar la vacunación contra la desinformación. Por ejemplo, si se hace de forma genérica, se advierte a las personas contra la amenaza general de que podrían estar mal informadas. Sin embargo, esto puede ser contraproducente, si con ello lo que conseguimos es, que la gente se muestre cínica sobre todas las formas de información, erosionando la creencia en los hechos y las falsedades».

Al examinar la información errónea utilizada en el debate sobre el cambio climático, Cook encontró que «las vacunas no reducen la confianza en los científicos, indicando que necesitamos ser más estratégicos en la forma de contrarrestar la desinformación».

Pero la mayoría de las veces, es difícil o imposible anticipar con precisión, qué tipo de información errónea o mentiras puede difundir un adversario. A veces, ni él lo sabe.

Consideremos a la Internet Research Agency (IRA), el grupo acusado por el FBI. El Washington Post, que habló con ex-empleados de la IRA, descubrió que los trolls no seguían normalmente guiones sino temas cuando producían contenidos, eventos, entradas en blogs y comentarios de chats. Crearon contenidos de forma continua y extemporánea, en un proceso de experimentación interminable.

Un ex-empleado describió cómo «él y sus colegas se involucraban en un grupo troll, en el que mantenían puntos de vista diferentes sobre el mismo tema y discutían sobre él, en comentarios públicos en línea. Finalmente, alguno de los miembros del grupo declaraba que se había convencido por otros. «Éste es el tipo de cosas que tuvimos que tuvimos que representar», dijo.»

Diferentes trabajadores desempeñaban tareas diferentes y, como señalan las acusaciones, asumieron personajes muy diferentes para difundir información errónea.

Entonces, ¿cómo se advierte a las víctimas potenciales sobre las noticias falsas, cuando el enemigo, por lo menos una parte de las veces, está improvisando?

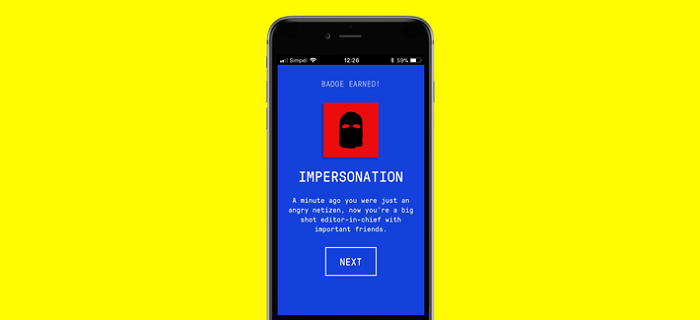

Los investigadores de Cambridge desarrollaron un juego para ayudar a la gente a entender, en general, cómo funcionan las noticias falsas, haciendo que los consumidores de noticias jugaran a ser trolls y crear desinformación. Al «poner a los consumidores en el lugar de los productores de noticias (falsas), no sólo están expuestos a pequeñas porciones de información errónea», escriben los investigadores.

Los jugadores asumieron varios papeles, algo así como la fábrica de trolls de San Petersburgo. Entre los papeles estaba el de «negador»: alguien «que se esfuerza por hacer que un tema parezca pequeño e insignificante», algo como las personas que afirman que los esfuerzos rusos para socavar a los gobiernos de todo el mundo están maquillados o son insignificantes. Otro fue «teórico de la conspiración»: alguien «que desconfía de cualquier tipo de narrativa oficial dominante y quiere que su audiencia siga el ejemplo», como un traficante de ficciones en el Pizzagate.

Lo que es más importante, los jugadores debían utilizar tácticas comunes en la desinformación y la retórica, como la hipérbole o la exageración; «whataboutism», o desacreditar a noticias o individuos, a través de acusaciones de hipocresía; y «razonamiento conspirativo», definido como «teorizar que grupos pequeños están trabajando en secreto contra el bien común», lo cual está en consonancia con la teoría cada vez más popular y aún infundada, de que el FBI está utilizando la investigación rusa para organizar un golpe.

¿Consiguió el juego vacunar con éxito a los jugadores contra las noticias falsas? Los investigadores hicieron que 57 personas jugaran, adoptando diferentes personajes y usando diferentes tácticas asociadas con la desinformación y la persuasión. En comparación con el grupo de control, los jugadores fueron mucho más escépticos sobre las noticias falsas que posteriormente se mostraron. Y esto independientemente de las inclinaciones políticas del jugador.»

Preguntamos a los participantes del grupo de control y a los del de tratamiento, cómo de fiable juzgaban que era su artículo [contra fáctico]», dijo el investigador Jon Roozenbeek. «También les preguntamos cómo de persuasivo pensaban que había sido. Los participantes pudieron responder en una escala de 1 a 7, y lo que encontramos es que el grupo de tratamiento calificó su artículo significativamente menos fiable y persuasivo con respecto al grupo de control. Esta es, por supuesto, una medida imperfecta. Desafortunadamente, nuestro estudio piloto no nos dio la oportunidad de explorar estas preguntas de una manera más profunda. Pero seguiremos haciendo estudios como este en el futuro, por lo que dispondremos de más datos

El estudio sugiere que, en realidad puede haber múltiples métodos para contrarrestar la desinformación, la propaganda y las noticias falsas de gobiernos como el de Vladimir Putin.

Dijo Cook acerca del Cambridge paper: «Roozenbeek y van der Linden proponen un enfoque novedoso: ‘vacunación activa’, haciendo que los estudiantes aprendan las técnicas de las noticias falsas, creando su propio artículo de noticias falso. Este enfoque activo les da a los estudiantes las herramientas de pensamiento crítico necesarias para ver a través de otros artículos de noticias falsos: una habilidad muy necesaria en estos días.»

Dijo: «Otra forma de vacunar a las personas contra la desinformación es a través de la ‘tecnocognición’: soluciones tecnológicas basadas en principios psicológicos. El ‘juego de noticias falso’ es potencialmente una poderosa solución de tecnocognición, ya que el concepto podría funcionar bien como un juego en línea, donde cualquier número de jugadores puede aprender activamente a ver a través de las técnicas de noticias falsas «.

Pero que los líderes políticos o las redes sociales lleguen a usar estas estrategias, o incluso aboguen por su uso, sigue siendo dudoso.

Fte. Defense One